はじめに

OpenAI から Codex Security が公開されたので、実際に手元のリポジトリで試してみました。

Codex Security は脆弱性を見つけるだけでなく、指摘内容の確認から修正PRの作成まで自然につながるため、AI開発のセキュリティチェックを組み込みやすいと感じました。

今回試したのは、自分で作っている Slack bot アプリのリポジトリです。本記事では、Codex Security の概要を簡単に整理したうえで、実際に触ってみた流れと、印象的だった点を紹介します。

この記事でわかること

- OpenAI の Codex Security がどんな機能なのか

- 実際に使うとどのような流れでスキャンできるのか

- 触ってみて特に良かった点はどこか

1. OpenAIのCodex Securityとは?

Codex Security は、接続した GitHub リポジトリに対してセキュリティスキャンを行い、検出結果の確認や修正提案、PR作成まで行える OpenAI の新機能です。

現時点では research preview として公開されており、事前に GitHub リポジトリとの接続や environment の設定が必要です。スキャンを実行すると、リポジトリ全体の結果に加えて、各検出内容について 何が問題か どう直すか どのように検証したか といった情報を確認できます。

単に指摘一覧が並ぶだけではなく、そのまま修正案の確認や PR 作成まで進めやすい設計になっている点が、この機能の面白さだと感じました。

参考:

- OpenAI公式発表: Codex Security now in research preview

- OpenAI Developers: Codex Security Overview

- OpenAI Developers: Codex Security Setup

2. 実際に触ってみた流れ

今回は、自分の Slack bot アプリのリポジトリに対して Codex Security を試しました。この bot は、Slack 上で受け取った情報をもとに一次情報を収集し、要約や音声化を行う用途で使っています。

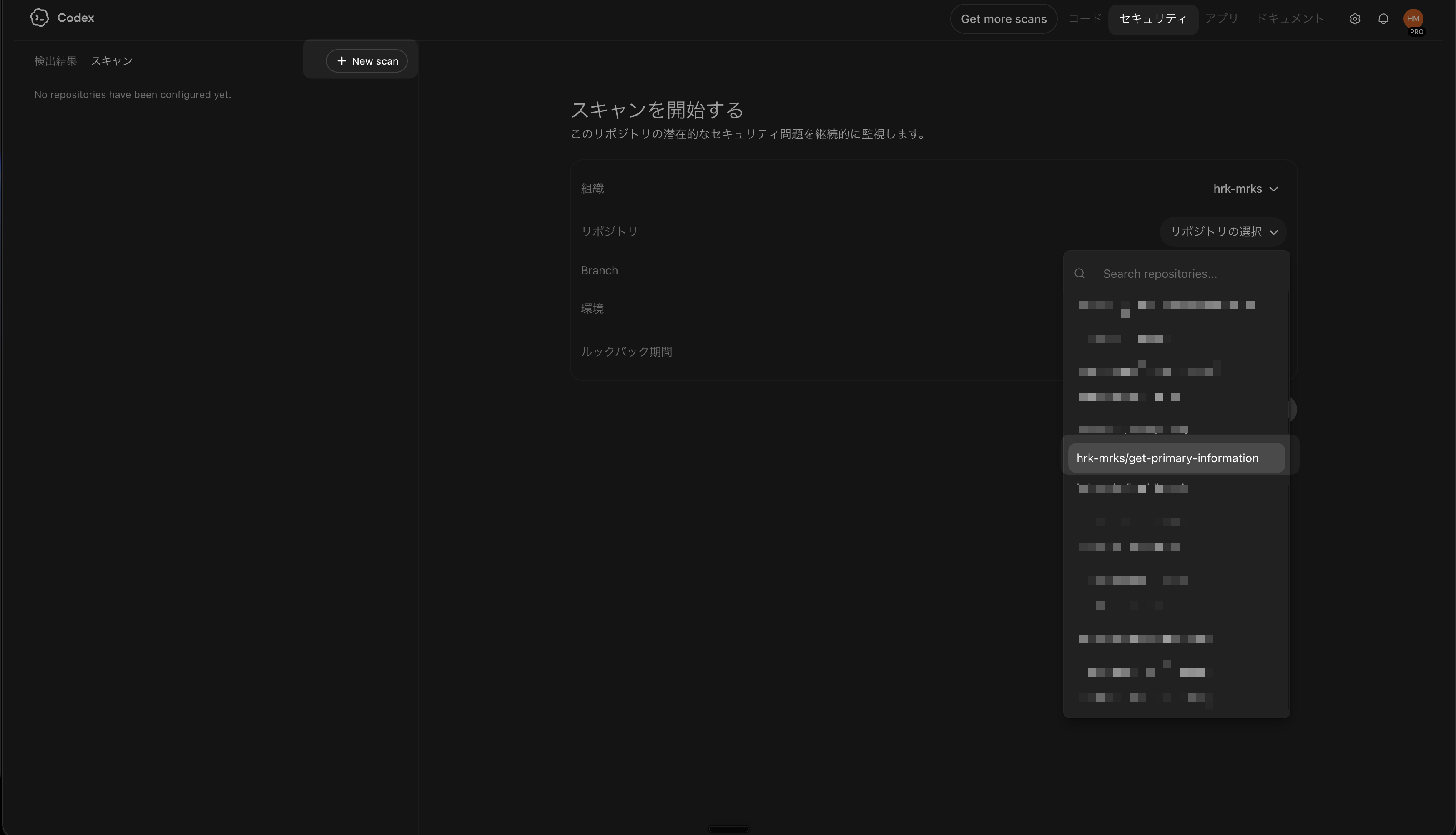

操作の流れはかなりわかりやすく、Codex から Security を開き、New scan を押して対象の organization / repository / branch / environment を選ぶだけで開始できました。

初回スキャンはやや時間がかかりました。自分が試したときは 30 分から 1 時間程度で、すぐに結果が返るというよりは、しばらく待って確認するイメージです。

スキャン画面では、Overview や threat model などがまとまっており、まずこのリポジトリをどう見ているのかを把握しやすい UI でした。個別の finding に入る前に全体像を見られるのは、良い設計だと思いました。

3. 実際に出た指摘の例

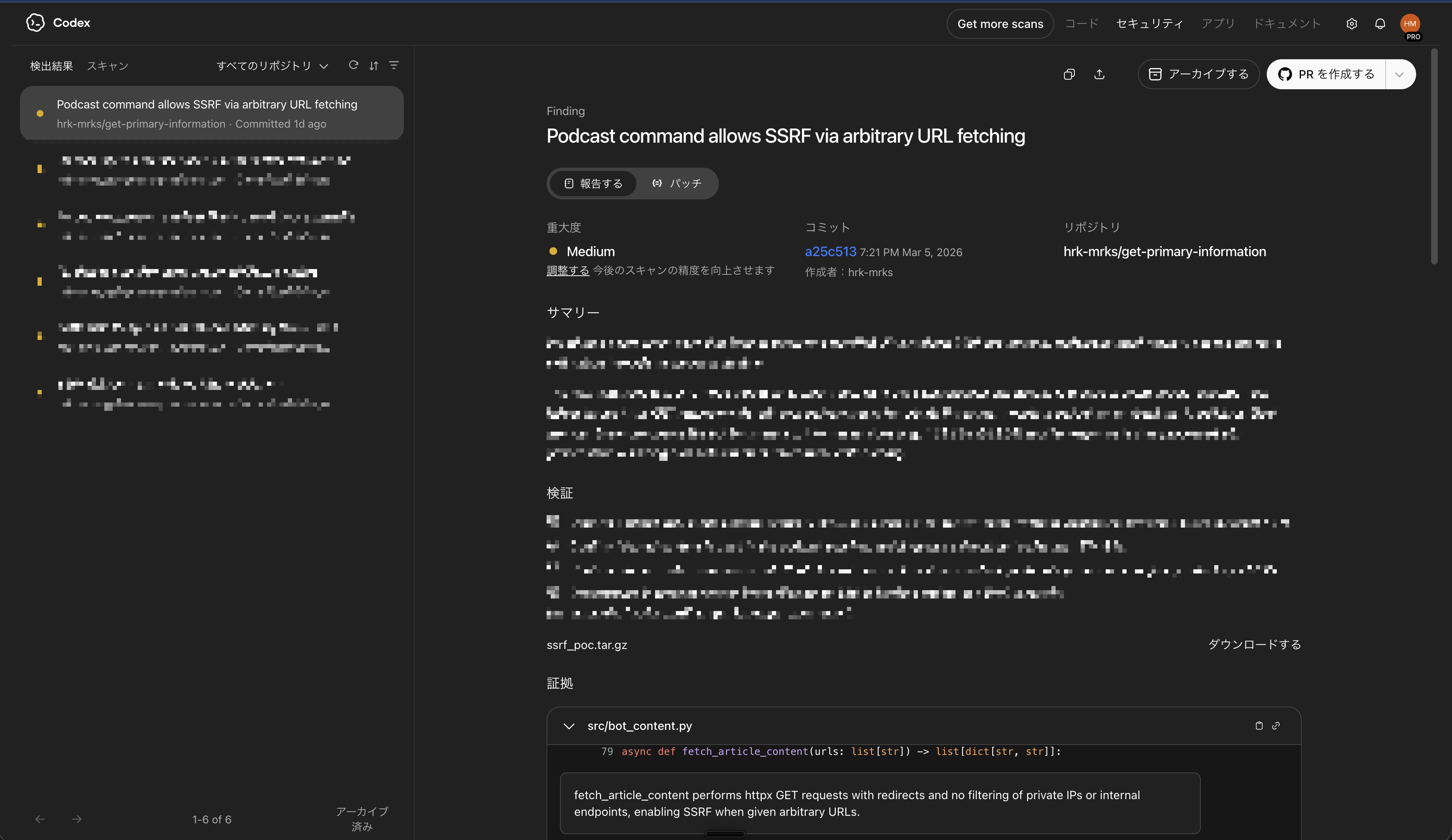

実際に出た指摘のひとつが、Slack 上で受け取った任意 URL をアプリ側で取得する処理に対する SSRF リスクでした。SSRF は、外部から渡された URL などをきっかけに、アプリが本来アクセスさせたくない先へアクセスしてしまう問題です。

この bot では、X の URL などをもとに LLM 側の Web search に加え、うまく取得できない場合はアプリ側で記事本文を取得してコンテキストとして使う処理があります。便利な機能ではある一方で、任意の URL をそのまま取得できる設計になっていると、悪意のある URL を経由して内部ネットワークやメタデータエンドポイントへアクセスされる可能性があります。

Codex Security では、この点について攻撃シナリオ込みで説明が付いており、単に 危険です で終わらず、なぜ問題なのかがわかりやすく整理されていました。

さらに修正案として、危険な URL の遮断に加えて、リダイレクトを自動追従せず、遷移先を都度再検証する対応が提案されていました。個人的には、この 指摘内容のわかりやすさ と 修正方針の具体性 が特に良いと感じました。

4. 良かったのは、修正PRまで自然につながること

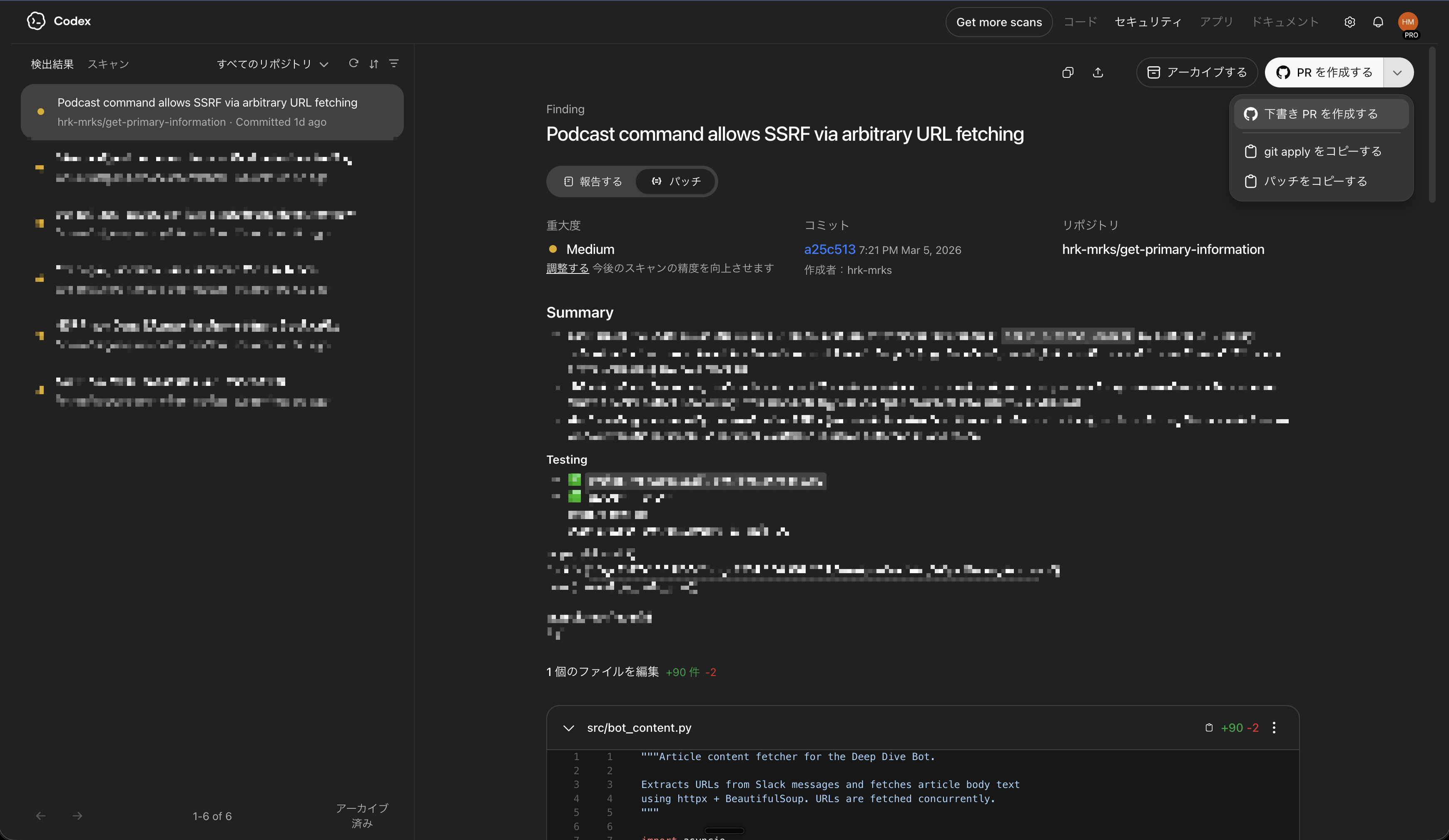

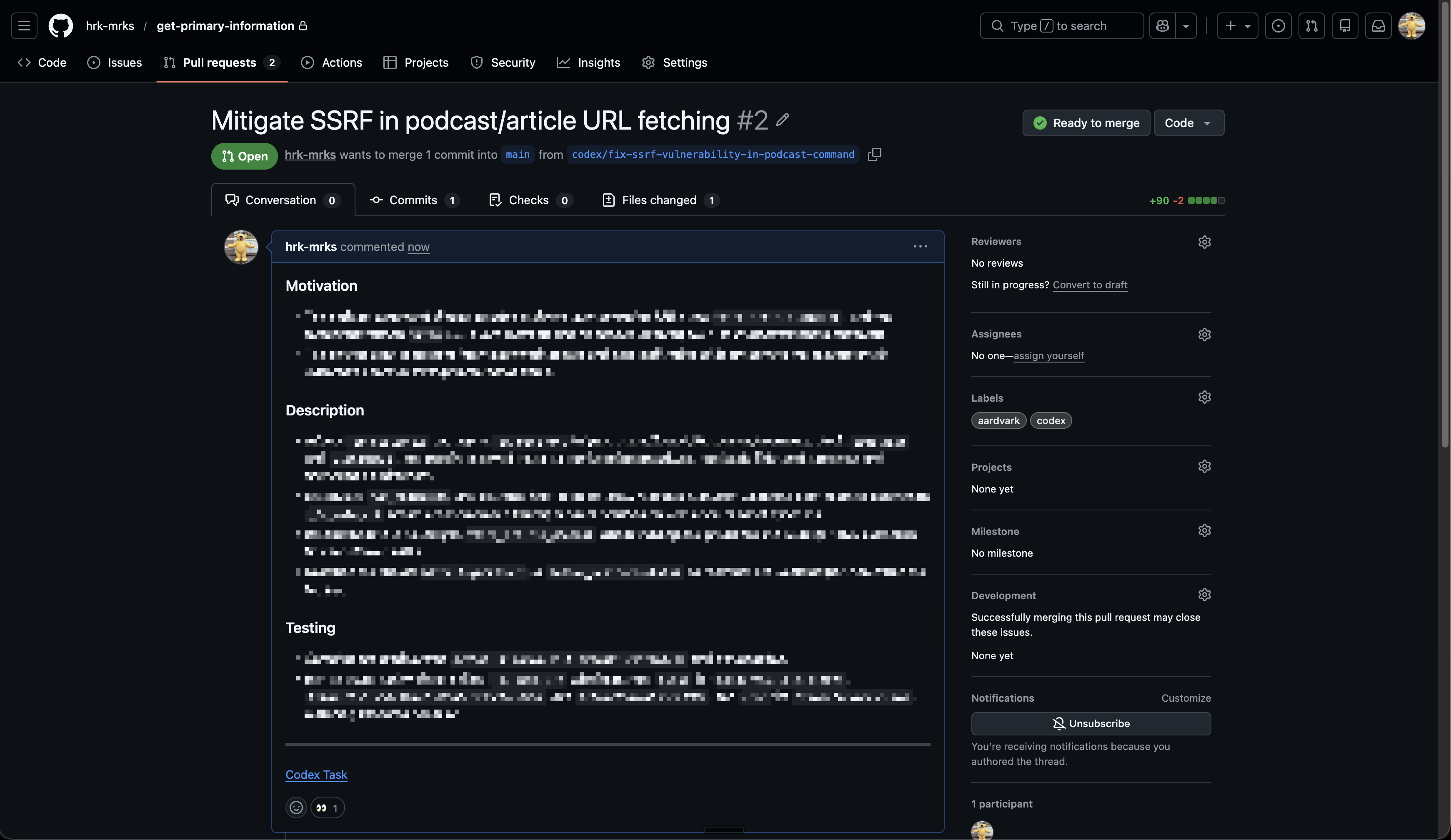

今回いちばん印象的だったのは、指摘をそのままレビュー可能な形で修正PRにつなげられることでした。

各 finding の詳細画面では、問題の説明、検証内容、修正案がまとまっており、その流れのまま PR を作成できます。検知して終わりではなく、ではどう直すか まで自然に進めるので、体験としてとてもスムーズでした。

特に良かったのは、UI/UX の動線が素直なことです。スキャン結果を見て、気になる指摘を開き、内容を確認し、そのまま修正PRに進めるので、途中で別のツールや別の人の作業に切り替わりにくい印象がありました。

AI コーディングで開発速度が上がるほど、後段のセキュリティ確認も同じくらい自然に差し込めることが重要になっていくと思います。その意味で、Codex Security は単なる新機能というより、AI 開発フローの中にセキュリティチェックを組み込みやすくする体験として、よく設計されていると感じました。

5. まとめ

OpenAI の Codex Security を実際に試してみて、全体としてかなり好印象でした。

脆弱性を見つけられること自体ももちろん有用ですが、特に良かったのは、指摘内容の確認から修正PRの作成までが自然につながっていたことです。AI 開発のスピードが上がるほど、このようにセキュリティチェックを途中に組み込みやすい体験の価値は大きくなりそうです。

公開直後の research preview ではありますが、新機能を追っている AI 好きな方や、個人開発で AI アプリを触っている方は、一度試してみる価値があると感じました。